近期,电子信息工程学院(机器人学院)周城老师、熊承义教授团队在遥感图像语义分割研究中实现新突破,为解决复杂场景下遥感图像目标边界模糊、多尺度特征提取难等行业痛点提供了全新技术范式。2 月初,团队最新研究成果以Edge-Guided and Multiscale Feature Optimization-Based Semantic Segmentation Network for Remote Sensing Images为题,在国际遥感领域顶级期刊IEEE Transactions on Geoscience and Remote Sensing(TGRS)(中科院一区TOP期刊)发表。论文链接:https://ieeexplore.ieee.org/document/11371341。

该项研究成果是校企协同、校校合作开展技术攻关的重要结晶。论文第一作者为周城老师,通讯作者为我校2025届校友、中国铁塔股份有限公司工程师蔡博锋,合作作者包括熊承义教授与武汉轻工大学刘仁峰副教授。

遥感图像语义分割是地理空间信息解译的核心环节,其精度直接决定智慧城市管理、土地利用分类、环境监测等下游应用的可靠性。然而在实际应用中,遥感图像存在目标尺度差异大、目标遮挡严重、类间相似度高等固有问题,极易造成目标边界模糊;传统卷积神经网络经池化操作后易丢失细粒度空间细节,现有Transformer模型处理高分辨率遥感数据时,又面临计算成本过高、局部高频细节保留不足等挑战。诸多因素成为制约该领域技术发展的关键瓶颈。

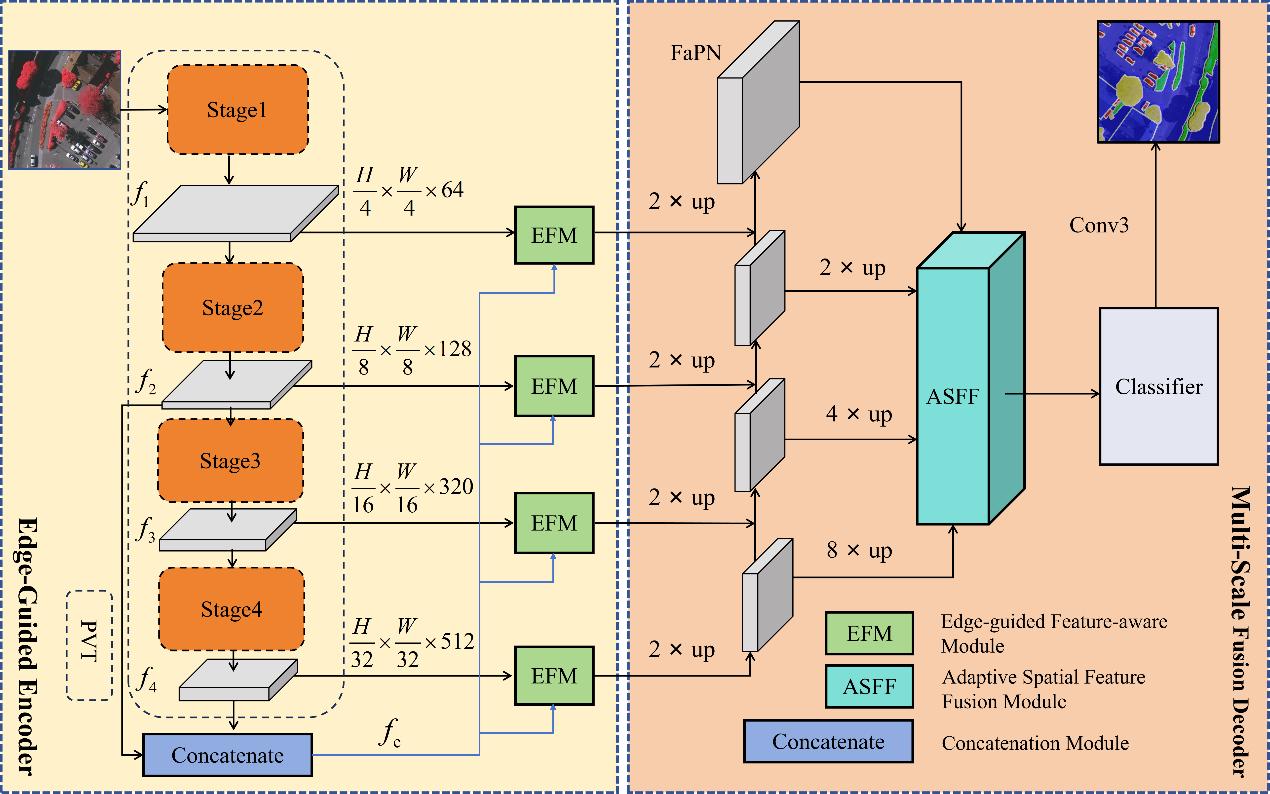

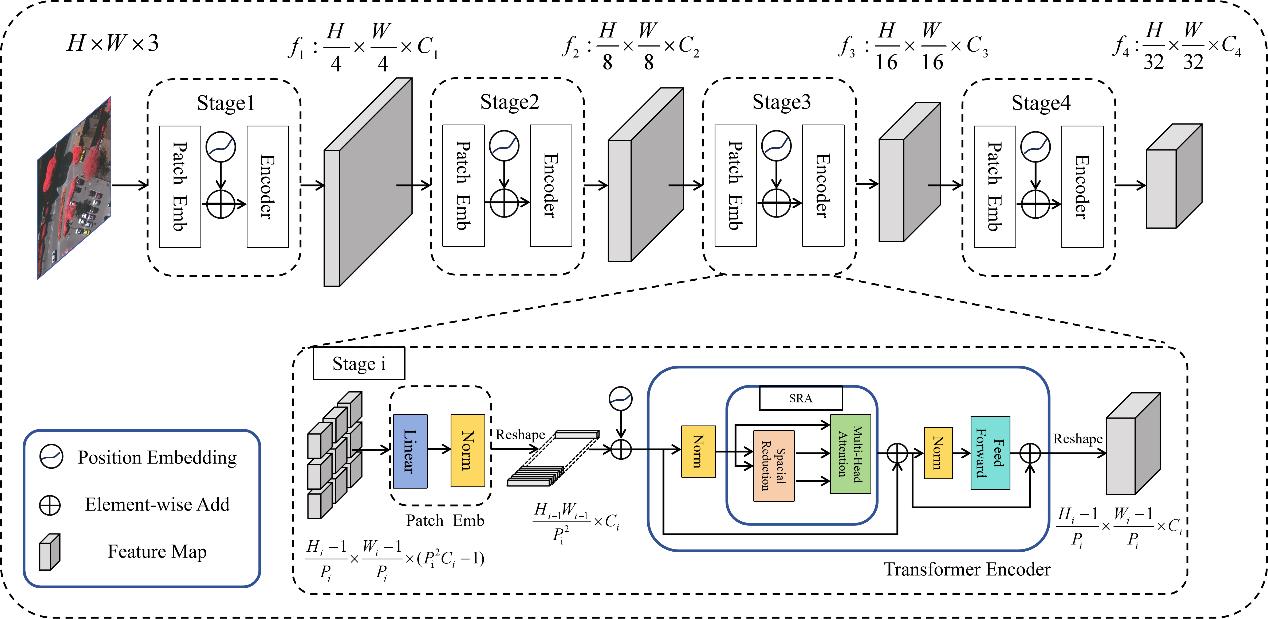

针对上述行业难题,研究团队创新性提出边缘引导与多尺度特征优化相结合的工程集成框架,为遥感图像语义分割打造了高效精准的技术解决方案。该框架以金字塔视觉Transformer(PVT)为基础,设计了边缘引导编码器,通过引入可学习的边缘引导特征模块(EFM),能够显示恢复采样过程中丢失的边界信息,从根源上缓解边界模糊问题;在解码器部分,团队融合特征对齐金字塔网络(FaPN)与自适应空间特征融合机制(ASFF),实现了跨尺度特征的精确对齐与动态智能选择,既能有效抑制背景噪声,又能在保留细粒度空间结构的同时,显著增强模型对小目标的感知能力,兼顾了分割精度与特征提取的全面性。

为验证模型性能,研究团队在 ISPRS Potsdam 和 LoveDA 两大国际主流大规模高分辨率遥感开源数据集上开展了系统实验。结果显示,该模型在平均交并比(mIoU)、像素准确率(aAcc)等语义分割核心评价指标上,显著超越 DeepLabV3+、SegFormer 等现有主流先进算法;同时,模型在参数量、计算复杂度与推理速度之间实现了极佳平衡,具备极高的实际工程部署价值和产业化应用潜力,为遥感图像语义分割技术的工程化落地提供了重要支撑。

论文内容示意。电信学院供图